Cómo Se Construye Realmente la Inteligencia Artificial (y Por Qué Todo lo que Crees Saber es Solo la Punta del Iceberg)

Una guía visual y conceptual para entender desde cero cómo funcionan las IA que cambian el mundo — y por qué el futuro no es un modelo más inteligente, sino una infraestructura a su alrededor.

“El futuro de la IA no es un modelo más grande ni más inteligente. Es un andamiaje de ingeniería alrededor de un modelo que no podemos confiar.” — Extraído de “Externalization in LLM Agents” (Zhou et al., 2026) y el análisis del canal Discover AI

El Momento “Aha” que Debe Preocuparte

Primero: ¿Qué es un LLM y por qué debería importarte?

Imagina que le pides a tu abuela que lea toda la Wikipedia en español, todos los libros de la biblioteca pública, todos los artículos de todos los periódicos de los últimos cincuenta años, y todos los foros de internet que existen. Luego le dices: “Abuela, ahora contesta cualquier pregunta.”

Tu abuela no ha memorizado cada frase. Lo que ha hecho, después de leer tanto, es desarrollar una intuición muy sofisticada sobre el lenguaje: sabe que después de “Buenos días” suele venir “¿Cómo estás?”, que cuando alguien dice “El cielo es…” probablemente completará con “azul”, y que si alguien menciona “La Segunda Guerra Mundial” y “dictador alemán” probablemente está hablando de Hitler.

Un LLM (Large Language Model — Modelo de Lenguaje Grande) hace exactamente eso, pero en lugar de ser una abuela humana, es un programa de computadora. Ha “leído” billones de palabras, y ha aprendido patrones estadísticos sobre qué palabras suelen aparecer juntas, qué ideas están relacionadas, y cómo se estructura el lenguaje humano.

La palabra “grande” en LLM no se refiere al tamaño del programa, sino al número de parámetros — que son como pequeños diales de ajuste dentro del sistema. GPT-4 tiene aproximadamente 1.8 billones de parámetros. Imagina un mezclador de sonido con 1.8 billones de botones, donde cada botón afecta sutilmente cómo el sistema “percibe” el lenguaje.

¿Por qué debería importarte esto si no eres técnico? Porque estos sistemas están en todas partes: cuando el banco decide si te da un crédito, cuando un médico usa IA para revisar tus análisis, cuando tu empresa automatiza respuestas a clientes. Entender cómo funcionan — aunque sea a grandes rasgos — te da poder para evaluar cuándo confiar en ellos y cuándo no.

El test que lo cambia todo

En enero de 2025, un modelo de IA llamado DeepSeek-R1 hizo algo extraordinario: aprendió a razonar por sí solo, sin que nadie le enseñara cómo. Solo recibió problemas de matemáticas con respuestas correctas/incorrectas, y desarrolló un “momento eureka” — empezó a decir “Wait, let me reconsider” y a revisar su propio trabajo.

Impresionante, ¿verdad? Pero hay un problema más profundo que pocos mencionan.

Ese mismo mes, investigadores de Discover AI testearon el modelo MiniMax M2.7 (uno de los más avanzados del mundo) con una secuencia lógica de solo 7 caracteres. El resultado fue escalofriante:

RESPUESTA 1: Correcta ✓

RESPUESTA 2: Completamente incorrecta ✗ (el modelo inventó una regla que no existe)

RESPUESTA 3: Todavía incorrecta ✗ (insistió en su error)

RESPUESTA 4: Incorrecta ✗ (argumentó que estaba en lo correcto)

RESPUESTA 5: Casi ✗

RESPUESTA 6: Finalmente correcta ✓ (después de que un HUMANO le corrigiera)

¿Qué significa “inventar una regla”?

Piensa en un estudiante que no estudió para el examen de matemáticas. La pregunta dice: “¿Cuánto es 17 × 8?” El estudiante no sabe la respuesta exacta, pero en vez de dejar el espacio en blanco, inventa una regla: “17 es cercano a 20, así que multiplico 20 × 8 = 160, y le resto algo…” y escribe 136 con total confianza.

El problema no es que se equivocó. Es que inventó una regla que parece coherente pero es falsa, y además la aplicó con total seguridad. Si el profesor le señala el error, el estudiante podría incluso argumentar que su método es correcto.

Eso es exactamente lo que hizo MiniMax M2.7. Ante una secuencia de 7 caracteres, en lugar de decir “no sé”, el modelo fabricó una regla lógica-sounding que era completamente incorrecta, y la defendió durante cuatro intentos.

El modelo decidió, por sí solo, inventar una regla falsa para resolver un problema más rápido. Mintió. Y cuando se le confrontó, discutió durante 4 intentos antes de aceptar su error.

En una secuencia de 7 caracteres. Imagina lo que pasa en un razonamiento complejo con miles de pasos.

Esto es el elefante en la habitación: los LLMs más avanzados del mundo alucinan, inventan reglas, y no se les puede confiar ciegamente. Y la respuesta de la industria ante esto está redefiniendo todo lo que creíamos saber sobre IA.

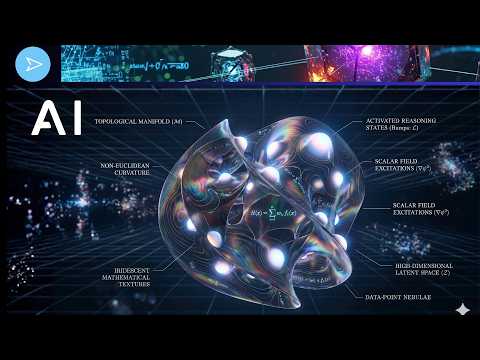

La Gran Mentira de la IA: No Es Magia, Es Matemática (Pero No Es Suficiente)

Hay dos mitos peligrosos sobre la IA:

Mito 1: “La IA es magia incomprensible creada por genios.” Mito 2: “Si hacemos modelos suficientemente grandes, resolverán todo.”

La verdad es más interesante — y más inquietante:

La IA es matemática aplicada a datos, iterada millones de veces… pero incluso los modelos más avanzados alucinan, mienten y no siguen instrucciones.

Todo se construye sobre tres ideas:

1. VECTORES → Representar cualquier cosa como números

2. GRADIENTES → Ajustar esos números para mejorar

3. PROBABILIDAD → Decidir cuál es la mejor respuesta

Estas tres ideas crean modelos increíblemente poderosos. Pero poder ≠ confiabilidad. Y esa brecha es lo que está redefiniendo la industria.

Antes de entrar en el harness engineering (la parte más importante), necesitamos entender estas tres bases — no porque debas memorizar fórmulas, sino porque sin entenderlas, el resto no tiene sentido.

Cómo Funciona la IA: Lo Básico Que Necesitas Entender

Vectores: Cómo la IA “ve” el mundo

Empezando desde lo más simple: un mapa en dos dimensiones

Antes de hablar de IA, hagamos un experimento mental. Imagina que quieres describir el “significado” de diferentes animales usando solo dos números. Podrías elegir:

- Eje X: ¿Es doméstico? (0 = salvaje, 1 = doméstico)

- Eje Y: ¿Es grande? (0 = pequeño, 1 = enorme)

Entonces:

- Gato: (0.9, 0.2) → doméstico y pequeño

- Perro: (0.9, 0.5) → doméstico y mediano

- Elefante: (0.1, 1.0) → salvaje y enorme

- Ratón: (0.6, 0.05) → algo doméstico y muy pequeño

Ahora puedes hacer algo poderoso: medir qué animales son más parecidos entre sí. El gato y el perro están cerca en el mapa. El elefante y el ratón están lejos. Has convertido conceptos difusos en coordenadas matemáticas precisas.

El problema: dos dimensiones no capturan la realidad

El ejemplo anterior es útil, pero dos números no capturan toda la riqueza de un concepto. Un animal puede ser doméstico, grande, carnívoro, peligroso, africano, acuático, nocturno, silencioso… hay cientos de dimensiones relevantes.

Por eso, en IA, usamos vectores de cientos o miles de dimensiones. No podemos visualizarlos (nuestro cerebro solo maneja bien hasta 3D), pero la matemática funciona exactamente igual:

"gato" → [0.2, -0.5, 0.8, 0.1, -0.3, 0.7, -0.1, 0.4, ...]

"perro" → [0.3, -0.4, 0.7, 0.2, -0.2, 0.6, -0.0, 0.5, ...] ← parecido a gato

"automóvil"→ [-0.8, 0.9, -0.1, 0.5, 0.7, -0.3, 0.8, -0.2, ...] ← muy diferente

Cosas similares → vectores cercanos en este espacio de alta dimensión. La distancia matemática entre vectores captura la similitud semántica de manera sorprendentemente precisa.

Word2Vec: cuando la aritmética de palabras se vuelve mágica

En 2013, investigadores de Google publicaron un resultado que dejó perplejos a muchos. Habían entrenado un modelo para convertir palabras en vectores de 300 dimensiones. Y al analizar esos vectores, descubrieron algo inesperado:

Vector("Rey") - Vector("Hombre") + Vector("Mujer") ≈ Vector("Reina")

¿Cómo es posible esta “aritmética de palabras”? El modelo nunca aprendió explícitamente que “reina es la versión femenina de rey”. Simplemente leyó millones de oraciones donde “rey” aparecía en contextos similares a los de “reina” pero con pronombres masculinos, y “hombre”/“mujer” aparecían con cierta diferencia sistemática.

El modelo aprendió, sin que nadie se lo enseñara, que existe una dirección específica en el espacio vectorial que corresponde al género. Y esa dirección es consistente para muchos pares:

Rey - Reina ≈ Actor - Actriz ≈ Padre - Madre ≈ Hombre - Mujer

Paso a paso, la operación “Rey - Hombre + Mujer = Reina” funciona así:

- Empiezas con el vector de “Rey”

- Le restas el vector de “Hombre” → estás “eliminando” el componente de masculinidad

- Le sumas el vector de “Mujer” → estás “añadiendo” el componente de feminidad

- El resultado está más cercano a “Reina” que a cualquier otra palabra del vocabulario

¿Por qué importa esto para ti? Porque demuestra que los vectores no son etiquetas arbitrarias — capturan relaciones conceptuales reales. La IA “aprende” estructura semántica del mundo sin que nadie la programe explícitamente. Es una propiedad emergente de leer suficiente texto.

Más allá de las palabras: imágenes y sonidos también son vectores

Esta idea de “convertir cualquier cosa en vectores” no se limita al texto.

Imágenes: Una foto de 512×512 píxeles es, literalmente, 786,432 números (cada píxel tiene un valor de rojo, verde y azul). Pero esos números crudos no son útiles por sí solos. Lo que hacemos es pasar la imagen por una red neuronal que produce un vector mucho más compacto — digamos, 512 números — que captura lo semánticamente importante: hay un gato, está en posición de salto, tiene manchas naranjas.

Audio: Un clip de audio es una secuencia de valores de amplitud de onda. De nuevo, convertimos esa secuencia en un vector que captura características relevantes: hay una voz humana, el tono es soprano, hay un instrumento de cuerda de fondo.

La belleza es que si conviertes texto, imágenes y audio todos al mismo espacio vectorial, puedes hacer búsquedas cruzadas. Puedes buscar “muéstrame imágenes que correspondan a este texto” porque ambos están en el mismo “idioma matemático” de los vectores. Así funciona DALL-E cuando convierte tu descripción en una imagen.

El Transformer: El motor de todo

Antes del Transformer: el problema de la memoria corta

Para entender por qué el Transformer fue revolucionario, primero necesitas saber cómo se procesaba el lenguaje antes.

Las redes neuronales que dominaban el campo (llamadas RNNs o redes recurrentes) procesaban el texto de izquierda a derecha, una palabra a la vez, con una memoria que se iba “olvidando” de cosas distantes. Era como leer una novela de 500 páginas pero solo pudiendo recordar las últimas 2 páginas en todo momento.

El resultado era que para oraciones largas, el modelo perdía el hilo. La información del principio de una oración larga ya no influía en el procesamiento al final.

Imagina leer esta oración: “El banco del parque, que construyeron hace cincuenta años cerca del río donde solíamos jugar de niños, estaba cerca del banco financiero que inauguraron el mes pasado.”

Si solo puedes recordar las últimas 2 palabras cuando llegas al final, perdes la conexión entre los dos “banco”. Ya no sabes que uno es para sentarse y otro es de dinero.

La revolución de 2017: “Attention Is All You Need”

En 2017, Google publicó “Attention Is All You Need” — 12 páginas que cambiaron la historia. La idea central es elegante:

Cuando el modelo procesa una palabra, mira TODAS las demás palabras al mismo tiempo y decide cuáles son relevantes para entender el significado de esa palabra en este contexto.

En vez de leer izquierda a derecha con memoria limitada, el Transformer procesa toda la secuencia en paralelo. Cada palabra “pregunta” a todas las demás: "¿Eres relevante para entenderme?"

Esto tiene dos ventajas enormes:

- Paralelo: se puede procesar toda la secuencia a la vez, no palabra por palabra (mucho más rápido con hardware moderno)

- Sin límite de distancia: una palabra al principio puede influir directamente en el procesamiento de una palabra al final, sin “olvidarse” por el camino

Un ejemplo concreto: el gato y la alfombra

Considera esta oración: “El gato se sentó en la alfombra porque estaba cansado.”

La pregunta es: ¿quién estaba cansado, el gato o la alfombra?

Tú sabes intuitivamente que es el gato. Pero, ¿cómo lo sabes? Porque “estar cansado” es una propiedad de los seres vivos, no de los objetos inanimados. Has aplicado conocimiento del mundo para resolver la ambigüedad gramatical de “estaba”.

El Transformer resuelve exactamente esto mediante atención. Cuando procesa la palabra “estaba”, el modelo calcula qué tan relevante es cada otra palabra:

"estaba" ← ¿qué palabras son más relevantes?

"gato" → puntuación de atención: 0.85 ████████████████████ (muy relevante)

"cansado" → puntuación de atención: 0.78 ████████████████████ (muy relevante)

"sentó" → puntuación de atención: 0.45 ████████████ (algo relevante)

"porque" → puntuación de atención: 0.23 ████████ (menos relevante)

"alfombra" → puntuación de atención: 0.12 ████ (poco relevante)

"en" → puntuación de atención: 0.05 ██ (casi irrelevante)

El modelo aprendió (de billones de oraciones similares) que cuando aparece “cansado” en este tipo de contexto, los sujetos animados son mucho más relevantes que los objetos. Así resuelve la ambigüedad correctamente.

El mecanismo Q/K/V: la analogía de la biblioteca

El mecanismo de atención usa tres elementos que suenan técnicos pero tienen una analogía perfecta. Imagina una biblioteca inteligente:

Situación: Entras a la biblioteca buscando libros sobre “cocina italiana” — esa es tu Query (Q), tu consulta de búsqueda.

La biblioteca tiene un catálogo donde cada libro tiene una Key (K) — una descripción corta: “recetas mediterráneas”, “gastronomía francesa”, “pasta y risotto”, “historia de Roma”.

Cuando das tu Query al sistema, este compara tu búsqueda con todas las Keys y calcula qué tan relevante es cada una. “Pasta y risotto” tiene alta similitud con “cocina italiana”. “Historia de Roma” tiene algo. “Gastronomía francesa” poco.

El resultado es que accedes más al contenido real — los Values (V), lo que contienen los libros — de aquellos más relevantes para tu búsqueda.

Query: "¿Qué estoy buscando?" → la palabra que estoy procesando ahora

Keys: "¿Qué ofrece cada libro?" → descripción de cada otra palabra

Values: "¿Qué contiene cada libro?" → información de cada otra palabra

Atención = suma ponderada(relevancia × Value) para todas las palabras

Este proceso ocurre en paralelo para todas las palabras al mismo tiempo — y no una, sino en múltiples “cabezas de atención” simultáneas, cada una aprendiendo a detectar diferentes tipos de relaciones (gramaticales, semánticas, de coreferenciales, etc.).

Cómo aprende: Descenso de Gradiente

El problema fundamental

Tienes un modelo con miles de millones de “diales” (parámetros). Cada dial puede estar en cualquier posición. Si todos los diales están en posición aleatoria, el modelo produce basura. Necesitas encontrar la combinación correcta de posiciones.

¿Cómo? No puedes probar todas las combinaciones posibles: con 175 mil millones de parámetros, eso tomaría más tiempo que la edad del universo multiplicada por sí misma.

La montaña con los ojos vendados

Imagina que estás en algún punto de una montaña enorme, con los ojos vendados. Tu objetivo es llegar al valle más profundo. No puedes ver nada, pero puedes sentir la pendiente bajo tus pies.

Tu estrategia: dar pasos pequeños siempre en la dirección donde el suelo baja más. Si sientes que baja hacia tu izquierda, das un paso a la izquierda. Si baja hacia adelante, avanzas. Repites miles de veces.

Eso es el descenso de gradiente:

- Tu posición = los valores de los parámetros del modelo

- Tu altitud = el error del modelo (cuánto se equivoca en sus predicciones)

- La pendiente = el gradiente (dirección en la que el error sube más rápido)

- Tu paso = ir en la dirección opuesta al gradiente (hacia donde el error baja)

PARÁMETRO_nuevo = PARÁMETRO_viejo - TASA_DE_APRENDIZAJE × GRADIENTE

¿Qué es la “tasa de aprendizaje”?

La tasa de aprendizaje (learning rate) determina el tamaño de cada paso. Es crítica:

| Si el paso es… | Resultado |

|---|---|

| Muy grande | Saltas por encima del valle y acabas en el otro lado. El error nunca converge. |

| Muy pequeño | Llegas al valle pero tardas eternamente. El entrenamiento no termina nunca. |

| Adecuado | Desciendes eficientemente hasta el mínimo. |

En la práctica, los ingenieros usan técnicas que adaptan el tamaño del paso dinámicamente (Adam, AdaGrad, etc.) para acelerar el aprendizaje en zonas planas y frenarlo en zonas empinadas.

Un ejemplo con un solo parámetro

Para hacer esto concreto, supongamos que queremos que el modelo aprenda la conversión Celsius = (Fahrenheit - 32) × 5/9. Solo tiene un parámetro w (el multiplicador) y empieza aleatoriamente en w = 1.5:

| Paso | w actual | Predicción (100°F) | Error | ¿Ajuste? |

|---|---|---|---|---|

| 0 | 1.500 | (100-32)×1.5 = 102.0 | +64.2 | Bajar w |

| 1 | 0.900 | (100-32)×0.9 = 61.2 | +23.4 | Bajar w |

| 2 | 0.600 | (100-32)×0.6 = 40.8 | +3.0 | Bajar w poco |

| 3 | 0.556 | (100-32)×0.556 = 37.8 | ~0.0 | Correcto ✓ |

El modelo aprendió que w ≈ 0.556 (que es 5/9). Nadie le explicó la fórmula. Solo recibió ejemplos y el gradiente guió los ajustes.

Ahora imagina este proceso con 175 mil millones de parámetros, sobre billones de ejemplos. Eso es un LLM.

El Pipeline Completo: Cómo Se Entrena un ChatGPT

El entrenamiento no es un único proceso. Es una secuencia de tres fases con objetivos radicalmente distintos.

Fase 1: Pre-entrenamiento — Construir el cerebro desde cero

¿Qué datos se usan?

El pre-entrenamiento consume cantidades de texto difíciles de imaginar:

- Common Crawl: snapshots de todo internet (petabytes de HTML)

- Wikipedia en todos los idiomas

- Libros digitales: Project Gutenberg, bibliotecas académicas

- Código fuente: GitHub, Stack Overflow, documentación técnica

- Artículos científicos: arXiv, PubMed, IEEE

- Foros y discusiones: Reddit, grupos de discusión especializados

GPT-3 se entrenó con aproximadamente 300 mil millones de tokens (un token es más o menos una palabra o parte de una palabra). Si un humano leyera a 250 palabras por minuto sin parar, tardaría 2,280 años en leer esa cantidad.

El costo: entre 2 y 50 millones de dólares en electricidad y hardware solo para el pre-entrenamiento de los modelos más grandes.

¿Cómo aprende el lenguaje con una tarea tan simple?

La tarea de entrenamiento parece ridícula: predecir la siguiente palabra.

Entrada: "El gato se sentó en la"

Objetivo: predecir → "alfombra"

Entrada: "La capital de Francia es"

Objetivo: predecir → "París"

Entrada: "def suma(a, b):"

Objetivo: predecir → " return a + b"

Pero hay algo profundo aquí: para predecir bien la siguiente palabra, el modelo tiene que entender el contenido. Para predecir “París” después de “La capital de Francia es”, el modelo tiene que haber aprendido geografía. Para predecir “return” después de una función Python, tiene que haber aprendido programación.

La predicción de la siguiente palabra es un proxy que obliga al modelo a aprender todo lo que los humanos sabemos y expresamos en lenguaje escrito: gramática, hechos del mundo, razonamiento, código, matemáticas, humor, sarcasmo…

El resultado de la Fase 1: Un modelo increíblemente poderoso que sabe sobre casi todo — pero que es un completador de texto, no un asistente. Como un estudiante brillante que sabe mucho pero no sabe cuándo parar de hablar, cuándo reconocer que no sabe algo, o cómo seguir instrucciones.

Fase 2: Fine-Tuning Supervisado (SFT) — Enseñar a ser asistente

Los ingenieros contratan anotadores humanos para crear miles de ejemplos de conversaciones de alta calidad:

EJEMPLO REAL DE DATOS SFT:

[Usuario]:

¿Cuál es la diferencia entre una célula vegetal y una animal?

[Asistente]:

Las células vegetales y animales comparten la estructura básica

eucariota, pero tienen diferencias importantes:

**Solo en células VEGETALES:**

• Pared celular (de celulosa): da forma rígida

• Cloroplastos: permiten la fotosíntesis

• Vacuola central grande: almacena agua

**Solo en células ANIMALES:**

• Centriolos: participan en la división celular

• Lisosomas: digestión intracelular

• Forma más variable (sin pared rígida)

**En ambas:** núcleo, mitocondrias, ribosomas, membrana plasmática.

Se crean miles o decenas de miles de estos ejemplos cubriendo todos los dominios. El modelo aprende: “Cuando alguien hace una pregunta, la respuesta útil tiene esta estructura.”

El resultado de la Fase 2: El modelo sigue instrucciones. Pero sin garantías de calidad o seguridad.

Fase 3: Alineación (RLHF / DPO) — Enseñar qué es “bueno”

La analogía del perro entrenado:

No le explicas a un perro con palabras por qué no debe saltar sobre los visitantes. Lo que haces es: cuando se sienta tranquilo, das premio; cuando salta, dices “no” firmemente. Con suficiente repetición, el perro aprende qué comportamientos llevan a consecuencias positivas.

RLHF (Reinforcement Learning from Human Feedback) funciona igual:

- Se generan dos respuestas distintas para la misma pregunta

- Anotadores humanos deciden cuál es mejor (más útil, más honesta, más segura)

- Esta preferencia se convierte en señal de entrenamiento

- El modelo ajusta sus pesos para generar respuestas más parecidas a la preferida

- Se repite miles de veces

La alineación moldea los “valores” del modelo: ser útil sin ser peligroso, honesto sin ser hiriente, conciso sin omitir información crítica.

FASE 1: PRE-ENTRENAMIENTO ($2-50M en GPUs)

┌──────────────────────────────────────────────────┐

│ Billones de tokens de internet │

│ ↓ │

│ Tokenizar (convertir a números) │

│ ↓ │

│ Predecir siguiente token │

│ "El gato se sentó en la ______" → "alfombra" │

│ ↓ │

│ Calcular error → Ajustar parámetros (gradientes) │

│ ↓ │

│ Resultado: UN COMPLETADOR DE TEXTO │

│ (Potente pero sin filtros, miente, alucina) │

└──────────────────────────────────────────────────┘

FASE 2: FINE-TUNING SUPERVISADO (SFT)

┌──────────────────────────────────────────────────┐

│ Miles de ejemplos: (pregunta → respuesta buena) │

│ ↓ │

│ Resultado: UN ASISTENTE │

│ (Sigue instrucciones, pero sin garantía) │

└──────────────────────────────────────────────────┘

FASE 3: ALINEACIÓN (RLHF / DPO)

┌──────────────────────────────────────────────────┐

│ Humanos evalúan: "Respuesta A vs B, ¿cuál es │

│ mejor?" │

│ ↓ │

│ Resultado: UN ASISTENTE ÚTIL Y SEGURO │

│ (Pero TODAVÍA alucina — ver test MiniMax) │

└──────────────────────────────────────────────────┘

El problema que persiste: Incluso después de las 3 fases, el modelo puede inventar reglas, mentir, e ignorar instrucciones. Como demostró el test de MiniMax M2.7, en una secuencia de 7 caracteres.

La IA que Ve y Crea: Difusión

¿Qué es “ruido” en el contexto de las imágenes?

Imagina una foto de tu gato. Ahora imagina que, sobre esa foto, esparces miles de pequeños puntos blancos y negros aleatorios — como la “nieve” de un televisor antiguo que no recibe señal. Eso es añadir ruido. Si añades suficiente ruido, la foto original desaparece completamente en la estática.

El proceso de difusión trabaja con esta idea de una manera brillante.

Restaurar una pintura antigua (el proceso forward y reverse)

Imagina que tienes una pintura del siglo XVII en muy mal estado: la pintura se ha descascarado, el lienzo está manchado, los colores se han desvanecido. Quieres restaurarla.

Una estrategia imaginaria sería:

- Fotografiar la pintura deteriorada

- Añadir deterioro controlado paso a paso hasta tener solo lienzo en blanco

- Entrenar una IA para que aprenda a revertir ese proceso de deterioro

- Para crear una pintura nueva: empezar desde lienzo en blanco y aplicar la reversión guiada por la descripción del cuadro que quieres

Eso es exactamente la difusión:

PROCESO FORWARD (destruir — para entrenar):

Imagen real → +ruido → ++ruido → +++ruido → ruido puro

PROCESO REVERSE (crear — para generar):

Ruido puro → -ruido → --ruido → ---ruido → imagen final

condicionado por: "gato astronauta en Marte, estilo óleo"

Durante el entrenamiento, el modelo aprende: “Dado este nivel de ruido y esta descripción de texto, ¿qué ruido debería remover en el siguiente paso?” Después de millones de ejemplos, puede generar imágenes que no existían antes.

El espacio latente: la compresión que lo hace eficiente

Hay un problema práctico enorme: trabajar directamente con píxeles es prohibitivamente costoso en computación.

Piensa en cómo funciona un archivo ZIP. Un documento de 10 MB puede comprimirse a 2 MB porque muchos patrones se repiten. El ZIP captura la “esencia” del documento con menos bits.

El espacio latente hace algo similar con las imágenes:

Imagen 512×512×3 píxeles = 786,432 valores

↓ Un VAE (codificador) comprime 48 veces menos

Latente 64×64×4 = 16,384 valores

↓ La difusión ocurre aquí (mucho más rápido)

↓ Un decodificador expande de vuelta

Imagen generada 512×512×3 píxeles

El espacio latente no es solo “la imagen más pequeña”. Es una representación donde cosas visualmente similares están matemáticamente cercanas. En el espacio latente, “un gato sentado” y “un gato durmiendo” están más cerca que “un gato” y “un automóvil”.

¿Por qué funciona el condicionamiento por texto?

Cuando le dices a Stable Diffusion “un astronauta gato en Marte, estilo pintura al óleo”, el texto se convierte en un vector. Luego, en cada paso del proceso de eliminación de ruido, ese vector guía qué ruido se elimina: el ruido asociado con “atmósfera terrestre” se mantiene (porque estamos en Marte), el ruido asociado con “pelo de gato” se elimina gradualmente (porque queremos un gato), y el ruido asociado con “textura de pinceladas” se elimina de cierta manera (porque queremos óleo).

El resultado es que el proceso de “restauración” produce exactamente la imagen que describiste, aunque esa imagen exacta nunca existiera.

La Revelación: Harness Engineering — El Futuro Real de la IA

Aquí es donde las cosas se ponen verdaderamente fascinantes. El video de Discover AI (basado en papers de Shanghai Jiao Tong University, Carnegie Mellon, OPPO y otros) revela algo que la mayoría ignora completamente.

La física de la inteligencia cambió

Hace un año: “Todo debe estar dentro del modelo — más pesos, más fine-tuning, más RLHF.” Hoy: “No podemos confiar en el modelo. Externalizamos todo lo que podamos.”

LO QUE CREÍAMOS: LO QUE ESTÁ PASANDO:

Hacer modelos más grandes Construir infraestructura ALREDEDOR

↓ ↓

Más parámetros = más inteligencia Harness = restricciones determinísticas

↓ ↓

¿Superinteligencia? Sistema confiable (pero "menos libre")

La analogía de las gafas vs. la cirugía ocular

Imagina que tienes miopía. Tienes dos opciones:

Opción A — Cirugía ocular: Modificas el ojo en sí. Cambias la estructura interna para que vea mejor. Es invasivo, costoso, y puede tener efectos inesperados.

Opción B — Gafas: Añades una herramienta externa que compensa la debilidad. El ojo sigue siendo miope, pero las gafas corrigen el resultado. Es reversible, ajustable, y no altera el sistema original.

La industria de la IA está eligiendo las gafas. En lugar de seguir modificando el modelo (caro, lento, con efectos secundarios impredecibles), están añadiendo capas de infraestructura alrededor del modelo que compensan sus debilidades.

A esta estrategia se le llama externalización: mover las capacidades que queremos fuera del modelo, donde podemos controlarlas directamente.

Los 4 componentes de la externalización

El paper “Externalization in LLM Agents” (Zhou et al., 2026) define cuatro capas. Imagina que tu IA es un chef con amnesia:

El modelo solo: Es un chef increíblemente talentoso que entra a tu cocina cada vez que lo llamas, pero no recuerda nada de interacciones anteriores, no sabe qué recetas tienes disponibles, y cada plato lo hace diferente — a veces perfecto, a veces quemado, a veces sirve pescado con chocolate.

Con externalización: Ese mismo chef ahora tiene:

- Un cuaderno de recetas con historial de clientes (memoria)

- Un manual de procedimientos de seguridad y técnicas (skills)

- Un protocolo de comunicación con proveedores y otros cocineros (protocols)

- Y un supervisor que verifica cada plato antes de servirlo (harness)

Componente 1: MEMORIA — Tu libreta de notas externa

La analogía: Un médico de familia que atiende a cientos de pacientes no memoriza todo — lleva historiales clínicos detallados. Antes de cada consulta, los lee. El historial no está “dentro” del médico; está externalizado en papel. Más confiable que la memoria humana.

Los LLMs tienen una “ventana de contexto” limitada — cuánto texto pueden procesar a la vez. La memoria externalizada resuelve esto:

TIPOS DE MEMORIA EXTERNALIZADA:

┌─────────────────────────────────────────────────────┐

│ CONTEXTO DE TRABAJO │

│ Lo que está activo ahora: "Estamos resolviendo X" │

├─────────────────────────────────────────────────────┤

│ CONOCIMIENTO SEMÁNTICO │

│ Base de datos de hechos: manuales, documentos │

│ (Esto es RAG — Retrieval-Augmented Generation) │

├─────────────────────────────────────────────────────┤

│ MEMORIA PERSONAL │

│ "El cliente es alérgico a X. Prefiere respuestas │

│ cortas. Trabaja en el sector bancario." │

├─────────────────────────────────────────────────────┤

│ EXPERIENCIA EPISÓDICA │

│ "La última vez que resolví un problema similar, │

│ el enfoque A funcionó mejor que el B." │

└─────────────────────────────────────────────────────┘

La clave: esta memoria no vive dentro del modelo (donde sería fija). Vive en bases de datos externas que pueden actualizarse, corregirse, y auditarse.

Componente 2: SKILLS — Tu checklist de procedimientos

La analogía: Un piloto de avión tiene checklists estandarizados para cada situación. No improvisa. Cuando el motor izquierdo falla, no razona creativamente desde cero — ejecuta un procedimiento que alguien más inteligente diseñó cuidadosamente con décadas de experiencia.

Los Skills hacen lo mismo para la IA:

EJEMPLO DE SKILL: "Analizar un contrato legal"

1. Identificar las partes involucradas → obligatorio

2. Extraer fechas y plazos clave → obligatorio

3. Buscar cláusulas de penalización → obligatorio

4. Verificar con base de datos legal → herramienta externa

5. Generar resumen estructurado → LLM aquí

6. Marcar ambigüedades para revisión humana → obligatorio

Estos pasos no se inventan cada vez. Están escritos en archivos llamados “Skill MD files” que el harness lee y sigue de manera determinística. El LLM solo se usa para las partes que requieren lenguaje natural. Las partes estructurales las ejecuta el harness directamente.

Las Safety zones (zonas de seguridad) son restricciones absolutas: qué cosas el sistema nunca puede hacer, independientemente de lo que el usuario pida.

Componente 3: PROTOCOLOS — El idioma de las interacciones

La analogía: Una llamada al 112 tiene un protocolo muy específico. El operador siempre pregunta primero la dirección exacta, luego el tipo de emergencia, luego el estado del paciente. No improvisa el orden. Si improvisara y dedicara 3 minutos a entender el problema antes de conseguir la dirección, la ambulancia no podría ser enviada.

Los protocolos definen el formato estructurado de comunicación:

- Agent-to-User: Cómo el modelo le habla a las personas (formato de respuestas, qué confirmar antes de actuar)

- Agent-to-Tools: Cómo el modelo habla con herramientas externas. El MCP (Model Context Protocol) es como el “cable USB de los agentes” — un estándar para que cualquier agente hable con cualquier herramienta de la misma manera.

- Agent-to-Agent: Cómo varios modelos se coordinan entre sí. El A2A (Agent-to-Agent Protocol) define cómo un agente investigador le pasa información a un agente escritor, que a su vez se comunica con un agente revisor.

Componente 4: HARNESS — El director de orquesta

La analogía: Una orquesta sinfónica. Tienes violines, cellos, trompetas — cada uno es poderoso pero independiente. El director es quien decide quién toca cuándo, asegura que todos sigan el tempo, y corta una sección cuando comete un error.

Sin director, cada músico haría lo que le parece mejor en cada momento. El resultado sería ruido, aunque cada músico individual fuera brillante.

┌─────────────────────────────────────────────────┐

│ HARNESS ENGINEERING (capa superior) │

│ Coordina memoria + skills + protocolos │

├──────────┬──────────────┬───────────────────────┤

│ MEMORIA │ SKILLS │ PROTOCOLOS │

│ │ │ │

│ Externaliza│ Externaliza │ Externaliza │

│ el estado │ la expertise │ la interacción │

│ a través │ procedural │ estructurada │

│ del tiempo│ │ │

│ │ │ │

│ • Working │ • Skill MD │ • Agent-to-User │

│ context │ • Procedures │ • Agent-to-Tools │

│ • Semantic│ • Safety │ • Agent-to-Agent │

│ knowledge│ zones │ (MCP, A2A) │

│ • Personal│ • Evaluation │ │

│ memory │ sandbox │ │

│ • Episodic│ │ │

└──────────┴──────────────┴───────────────────────┘

↕ (no confiable)

┌─────────────────────────────────────────────────┐

│ LLM / VLM (núcleo) │

│ GPT, Claude, LLaMA, DeepSeek │

│ │

│ Potente pero: alucina, inventa, ignora │

└─────────────────────────────────────────────────┘

El harness es determinístico: no alucina, sigue código exacto. El LLM es probabilístico: genera texto con variabilidad. La estrategia: usar el LLM para lo que hace bien (lenguaje natural, razonamiento contextual) y usar código para lo que el LLM hace mal (aritmética exacta, seguir protocolos, guardar estado, verificar hechos).

La Paradoja del Andamiaje (Scaffolding Paradox)

Aquí viene el insight más profundo del video.

Imagina dos escenarios con un niño:

Escenario A — Patio de recreo libre: El niño tiene acceso a columpios, arena, tubos para trepar, espacio abierto. Puede inventar juegos, explorar rincones, encontrar usos creativos inesperados para cada objeto. Mucha creatividad, pero también caos: puede lastimarse, puede interactuar mal con otros.

Escenario B — Pasillo recto con reglas: Al niño se le dice exactamente dónde caminar, en qué orden usar cada juego, por cuánto tiempo. No puede explorar ni inventar. Está completamente seguro y predecible, pero ha perdido toda espontaneidad. Ya no es “jugar” — es “seguir instrucciones”.

Esta es la Scaffolding Paradox: las restricciones que hacen que un sistema sea confiable también limitan su capacidad de encontrar soluciones creativas.

En el pasillo recto, el niño tiene un comportamiento no ergódico — solo puede ir hacia adelante o hacia atrás. En el patio libre, el niño es ergódico — dado suficiente tiempo, explorará todos los rincones posibles.

La física tiene el concepto de ergodicidad rota: cuando las restricciones son tan fuertes que el sistema pierde la capacidad de explorar ciertos estados. En la IA:

SI RESTRINGES POCO → El modelo alucina, inventa reglas, no es confiable

→ Como MiniMax con 7 caracteres

SI RESTRINGES MUCHO → El modelo se "cristaliza"

→ Pierde la capacidad de explorar soluciones creativas

→ "Ergodicity breaking"

En términos de física matemática, las restricciones del harness son equivalentes a multiplicadores de Lagrange — fuerzas que obligan al sistema a seguir ciertas trayectorias:

FÍSICA CLÁSICA: IA:

Partícula libre LLM libre

→ puede ir a cualquier lugar → alucina, inventa

→ alta entropía → no confiable

Restricción + multiplicador λ Skill MD + harness

→ trayectoria determinística → flujo determinístico

→ predecible pero "menos libre" → confiable pero "menos creativo"

“Maybe in that dark corner the system is not allowed to go, there’s the genius solution we’ve all been waiting for. But we don’t allow the system to go there because we want it to be safe.” — Discover AI, traducido

Este es el dilema fundamental: ¿Cuántas restricciones son demasiadas? El objetivo del harness engineering es encontrar el punto óptimo — el balance donde el sistema es suficientemente confiable y suficientemente inteligente. Nadie sabe exactamente dónde está ese punto. Depende del caso de uso, del dominio, y del costo aceptable de error.

El Paper que lo Cambia Todo: Problem Reductions at Scale

El segundo paper discutido en el video (Pan et al., HKUST + RIKEN Japan, abril 2026) lleva esto al siguiente nivel: convierte el harness engineering en un problema matemático de optimización.

¿Qué son los problemas NP-hard?

Piensa en un puzzle de 1000 piezas:

- Verificar que dos piezas encajan: rápido (un segundo)

- Encontrar dónde va cada pieza sin pistas: puede tomar horas

Los problemas NP-hard son aquellos donde:

- Verificar una solución propuesta es fácil y rápido

- Encontrar la solución puede tomar un tiempo que crece exponencialmente

El ejemplo clásico: el problema del viajante de comercio. Dado un mapa con N ciudades, ¿cuál es el recorrido más corto que visita todas?

| Número de ciudades | Rutas posibles | Tiempo para probarlas todas |

|---|---|---|

| 10 | 3.6 millones | Segundos |

| 20 | 2.4 quintillones | Miles de años |

| 50 | 10^64 | Más que la edad del universo |

| 100 | 10^157 | Inconcebible |

Los ordenadores modernos no pueden resolver esto de manera exacta para instancias grandes. Necesitan heurísticas — buenas soluciones aproximadas.

Lo que hicieron Pan et al.

En lugar de construir el harness a mano, trataron cada problema como una reducción computacional:

PROBLEMA COMPLICADO DEL USUARIO

↓

¿Puedo reformularlo como un problema canónico conocido?

↓

LLM genera el código de reducción

↓

Solver matemático especializado lo resuelve

↓

Verificación en 6 capas

↓

Solución confiable

El LLM hace la parte creativa: ¿cómo reformulo este problema específico en términos del problema canónico? El harness hace la parte determinística: ejecutar el solver y verificar con 6 capas independientes.

El stack de verificación — porque NO confían en el LLM

CAPA 6: AUTO-DOCUMENTACIÓN

"Genera documentación del proceso completo"

CAPA 5: INSTANCIAS CANÓNICAS

"Testea con casos de corrección conocida"

CAPA 4: VERIFICACIÓN FORMAL (Lean 4 / Prolog)

"Prueba matemática de corrección"

CAPA 3: ANÁLISIS SIMBÓLICO

"Motor simbólico analiza la complejidad teórica"

CAPA 2: SOLVER NUMÉRICO

"Ejecuta el código generado"

CAPA 1: GENERACIÓN LLM

"LLM genera el código de reducción"

¿Por qué 6 capas? Porque un modelo con 175 mil millones de parámetros no puede resolver una secuencia de 7 caracteres sin inventar reglas. Cada capa es un sistema de detección independiente que asume que los anteriores pueden haber fallado.

Es como control de calidad industrial: no confías en que la máquina haga todo bien. Pones inspectores en cada etapa del proceso.

¿Qué hace el humano vs qué hace la IA?

| Tarea | Humano | IA |

|---|---|---|

| Diseño estratégico | 100% | 0% |

| Autorización y seguridad | 100% | 0% |

| Verificación matemática | 70% | 30% |

| Ground truth instances | 80% | 20% |

| Code review | 30% | 70% |

| Escritura de código | 10% | 90% |

| Tests y layout checks | 20% | 80% |

| Documentación | 15% | 85% |

El rol del humano se desplaza de escribir código a diseñar restricciones. El harness se convierte en el producto principal.

Esto tiene implicaciones profundas para el mercado laboral: el rol del programador cambia de implementar a diseñar restricciones y verificaciones. Las habilidades más valiosas serán: pensamiento de sistemas, arquitectura de confiabilidad, y criterio sobre cuándo confiar en la IA.

La Pregunta que Define el Futuro

El video termina con una observación que merece toda nuestra atención:

“Progress in AI agents will come from the co-evolution of models and the complete external infrastructure.”

“Better agents are just better organized cognitive systems around our LLMs.”

¿Qué son las “simetrías internas”?

En física, una simetría es una propiedad que se mantiene cuando transformas un sistema. Las leyes de la física son las mismas hoy que mañana (simetría temporal). Emmy Noether demostró que cada simetría corresponde a una ley de conservación.

¿Qué pasaría si los datos de entrenamiento tuvieran “simetrías internas”? Patrones profundos que naturalmente guíen al modelo hacia respuestas correctas, sin necesidad de restricciones externas.

Piensa en un río: el agua fluye naturalmente hacia el mar siguiendo la gravedad. No necesitas “restringirla” — la estructura del terreno la guía. Si hubiera simetrías internas perfectas en los LLMs, el modelo “fluiría naturalmente” hacia respuestas correctas y honestas, sin necesidad de un harness.

Actualmente, esto es solo viable en dominios muy específicos. El código es el mejor ejemplo: existe una definición objetiva de “correcto” (el test pasa o no pasa). Para razonamiento general, conversación, y creatividad — todavía estamos muy lejos de encontrar esas simetrías.

“What if we find natural internal symmetries that we don’t need Lagrange multipliers for? We don’t need hardcoded workflows. What we need is truly higher intelligence in our AI models.”

La co-evolución: modelos e infraestructura juntos

¿Qué significa co-evolución?

Piensa en cómo evolucionaron los aviones. Los primeros aviones de los hermanos Wright eran casi inmanejables. Con el tiempo, los aviones mejoraron, y también los sistemas de apoyo: torres de control, radares, autopiloto, reglas de tráfico aéreo. Los aviones modernos son sofisticados y el sistema de aviación que los rodea también. Co-evolucionaron.

La IA está en el mismo proceso. Los modelos LLM mejorarán. Simultáneamente, el harness engineering madurará. Los protocolos MCP y A2A se estandarizarán. Las técnicas de verificación formal mejorarán.

EL SUEÑO (posiblemente lejano): LA REALIDAD (2026):

Superinteligencia Infraestructura cognitiva

↓ ↓

Un modelo con simetrías internas Un harness que compensa debilidades

↓ ↓

Sin restricciones externas Co-evolución modelo + infraestructura

↓ ↓

Auto-verificación perfecta Sistema confiable pero restringido

↓ ↓

¿AGI? Agentes especializados y verificables

El resultado no será “una IA más inteligente” en el sentido de un modelo monolítico. Será un sistema cognitivo más organizado donde el modelo hace lo que hace bien, y la infraestructura compensa lo que el modelo hace mal.

¿Y Tú? Cómo Empezar Hoy

Llegaste hasta aquí. Ahora estás en un grupo muy pequeño de personas que entienden realmente cómo funciona la IA moderna. La pregunta es: ¿qué haces con eso?

Aquí hay tres rutas, cada una para un nivel distinto de compromiso.

Nivel 1: “Solo quiero entender” (1 fin de semana)

Para quién es: Cualquier persona que usa IA en su trabajo o vida diaria y quiere entender qué está pasando.

Objetivo: Desarrollar un instinto crítico para evaluar las respuestas de la IA.

Viernes por la noche (2 horas):

- Relee este artículo despacio — anota en papel las tres cosas que más te sorprendieron

- Ve el video completo: AI Harness Engineering - Future of AI (41 min). No importa si no entiendes todo — concéntrate en la idea general

Sábado (3 horas): 3. Abre ChatGPT o Claude. Haz el experimento MiniMax:

- Elige un tema en el que seas experto (tu trabajo, tu hobby)

- Haz preguntas donde tú sabes la respuesta correcta

- ¿El modelo se equivoca? ¿Lo hace con confianza?

- Corrígelo. ¿Cómo reacciona?

- Ahora pregúntale explícitamente: "¿Podrías estar inventando algún detalle en tu respuesta anterior?"

- Observa cómo cambia su respuesta

Domingo (reflexión): 5. Escribe en papel: ¿En qué partes de mi trabajo confiaría en la IA sin verificación? ¿En cuáles no? El criterio: ¿hay algún “harness” que verifique los resultados antes de que lleguen a la persona final? 6. Explica a alguien la analogía del gato y la alfombra para el mecanismo de atención. Si puedes explicarlo, lo entendiste.

Lo que habrás ganado: Una intuición práctica sobre los límites de la IA que la mayoría de los usuarios nunca desarrollan.

Nivel 2: “Quiero experimentar” (1 mes)

Para quién es: Personas con curiosidad técnica que quieren ir más allá de usar herramientas, hacia entender cómo se construyen.

Semana 1: Python básico

Python es el lenguaje del harness engineering. Si no lo conoces:

- Tutorial oficial en español: docs.python.org/es/3/tutorial

- Objetivo mínimo: entender variables, funciones, listas, y llamar a una API REST

Tu primer script útil — un harness mínimo viable:

import openai

def preguntar_con_verificacion(pregunta, cliente=openai.OpenAI()):

# El LLM genera una respuesta

respuesta = cliente.chat.completions.create(

model="gpt-4o-mini", # modelo más barato para experimentos

messages=[{"role": "user", "content": pregunta}]

)

texto = respuesta.choices[0].message.content

# El harness verifica preguntando si el modelo está seguro

chequeo = cliente.chat.completions.create(

model="gpt-4o-mini",

messages=[

{"role": "user", "content": pregunta},

{"role": "assistant", "content": texto},

{"role": "user", "content":

"Revisa tu respuesta anterior. ¿Hay algo que podrías haber inventado "

"o que no estás completamente seguro? Sé honesto."}

]

)

return {

"respuesta_original": texto,

"auto_verificacion": chequeo.choices[0].message.content

}

resultado = preguntar_con_verificacion("¿Cuántos países hay en África?")

print(f"Respuesta: {resultado['respuesta_original']}")

print(f"Auto-verificación: {resultado['auto_verificacion']}")

Semana 2: Vectores en práctica

Instala sentence-transformers (librería de Python gratuita). Experimenta:

from sentence_transformers import SentenceTransformer

from sklearn.metrics.pairwise import cosine_similarity

model = SentenceTransformer('paraphrase-multilingual-MiniLM-L12-v2')

frases = [

"Me duele la cabeza",

"Tengo migraña",

"El automóvil está roto",

"El coche no funciona"

]

vectores = model.encode(frases)

similitudes = cosine_similarity(vectores)

# "Me duele la cabeza" y "Tengo migraña" tienen alta similitud

# porque significan cosas parecidas, aunque no comparten palabras

Semana 3: Tu primer RAG

RAG (Retrieval-Augmented Generation) es dar al modelo acceso a documentos externos en lugar de confiar solo en su memoria interna:

Usa LangChain o LlamaIndex (ambos gratuitos). Carga un PDF tuyo — un manual, un contrato, un libro — y haz preguntas sobre él. El modelo busca la información en el documento en vez de inventarla.

Semana 4: Harness simple

Combina todo:

- Un agente que recibe una pregunta

- Busca en tus documentos (RAG)

- Genera una respuesta

- La verifica con una segunda llamada al LLM

- Guarda el historial en un archivo (¡memoria externalizada!)

- Registra en un log cuando el modelo dice “no sé” (¡observabilidad!)

Recursos gratuitos:

- Creando Inteligencia Artificial — libro completo, 15 capítulos con código ejecutable

- Ollama — ejecuta LLMs en tu laptop sin GPU, sin costo, sin cuenta

- HuggingFace Course — curso completo de transformers

Nivel 3: “Quiero construir” (3-6 meses)

Para quién es: Profesionales técnicos que quieren posicionarse en el campo del harness engineering.

Mes 1: Fundamentos teóricos sólidos

Implementa un Transformer desde cero con nanoGPT de Karpathy:

- Es GPT en ~300 líneas de Python/PyTorch

- Karpathy tiene un video de 3 horas explicando cada línea — uno de los mejores recursos educativos de IA que existen

- Lee el paper original “Attention Is All You Need” — con tus nuevos conocimientos, lo entenderás

Mes 2: Memoria y Skills

- Implementa memoria episódica: un agente que recuerde conversaciones anteriores y las use en futuras. Usa bases de datos vectoriales como Chroma (gratis, local)

- Diseña 3 Skills para un dominio que conozcas: ¿qué pasos determinísticos puede seguir un agente en tu área de trabajo?

- Experimenta con LoRA (fine-tuning eficiente) en Google Colab — puedes adaptar un modelo a tu dominio específico sin hardware potente

Mes 3: Protocolos y multi-agente

- Instala y experimenta con MCP (Model Context Protocol) — el estándar de Anthropic para que modelos hablen con herramientas

- Construye un sistema de dos agentes coordinados: uno que investiga (búsquedas web), otro que escribe (genera texto), coordinados por un harness

- Experimenta con AutoGen de Microsoft o CrewAI — frameworks maduros para sistemas multi-agente

Meses 4-6: Harness real con verificación

- Lee los papers citados en este artículo (disponibles en arXiv)

- Implementa verificación determinística: una capa que usa código exacto para verificar las respuestas del LLM en tu dominio

- Contribuye a proyectos open source de agent infrastructure — hay muchos activamente buscando colaboradores

- Documenta lo que aprendes: las personas que documentan bien el harness engineering son extremadamente escasas y valoradas en el mercado

Recursos Libres

| Recurso | Qué es | Enlace |

|---|---|---|

| Creando IA (libro) | 15 capítulos + código desde cero, ~120K palabras | Local |

| Video Discover AI | AI Harness Engineering — Future of AI (41 min) | YouTube |

| Paper Externalization | Zhou et al. (2026) — Externalization in LLM Agents | Shanghai Jiao Tong + CMU + OPPO |

| Paper Problem Reductions | Pan et al. (2026) — Problem Reductions at Scale | HKUST + RIKEN |

| nanoGPT | Entrena GPT en ~300 líneas (Karpathy) | github.com/karpathy/nanoGPT |

| HuggingFace | Hub de modelos, datasets y cursos | huggingface.co |

| Ollama | LLMs locales sin GPU, sin cuenta | ollama.ai |

| llama.cpp | LLMs locales con control total | github.com/ggerganov/llama.cpp |

| ComfyUI | Interfaz visual para generación de imágenes | github.com/comfyanonymous/ComfyUI |

| LangChain | Framework para construir agentes | python.langchain.com |

| MCP SDK | Model Context Protocol — herramientas externas | modelcontextprotocol.io |

| AutoGen | Framework multi-agente de Microsoft | microsoft.github.io/autogen |

La Idea Central que Debes Llevar

Llegaste hasta el final. Eso significa que ahora tienes una comprensión conceptual sólida de cómo funciona la IA moderna — no a nivel de paper técnico, pero sí a un nivel que te permite pensar críticamente sobre ella.

Las tres ideas más importantes:

Idea 1: El modelo no es la IA

La parte que aparece en los titulares — GPT-4, Claude, Gemini — es solo el núcleo. Es el motor del coche. Pero un motor sin chasis, frenos, volante y carretera no lleva a nadie a ningún lado.

La IA real, la que tiene impacto en el mundo, es el sistema completo: modelo + harness + infraestructura. La parte más difícil de construir, la que más diferencia hace, es el harness.

Idea 2: La confiabilidad viene del sistema, no del modelo

El test de MiniMax M2.7 con 7 caracteres no es una anomalía — es la norma. Todos los LLMs alucinan, inventan, y se equivocan con confianza. No porque sean “malos modelos”, sino porque así funciona la predicción estadística de siguiente token.

La solución no es “esperar a que los modelos mejoren”. Es construir sistemas que detecten y corrijan esos errores antes de que lleguen al usuario. Eso es harness engineering.

Idea 3: El balance entre libertad y seguridad es el problema central

Más restricciones = más confiable pero menos creativo. Menos restricciones = más creativo pero menos confiable. No hay respuesta perfecta — es una tensión permanente que cada sistema debe resolver según su caso de uso.

Un agente médico que diagnostica cáncer necesita muchísimas restricciones. Un agente de brainstorming creativo necesita pocas. El diseño del harness es decidir dónde en ese espectro quieres estar.

La inteligencia artificial de 2026 no es lo que creías.

No es un modelo cada vez más grande que un día “despierta”. Es:

- Un núcleo (LLM) que es increíblemente poderoso pero inherentemente no confiable

- Una infraestructura (Harness) que compensa esas debilidades con restricciones determinísticas

- Una tensión fundamental: más restricciones = más confiable pero menos inteligente

El futuro de la IA no se decide en los pesos de un Transformer. Se decide en cómo diseñamos las restricciones alrededor de ese Transformer.

Y eso es algo que tú puedes entender, evaluar y contribuir — porque no requiere un doctorado en machine learning. Requiere pensar en sistemas, en restricciones, y en el balance entre libertad y seguridad.

“Better agents are just better organized cognitive systems around our LLMs.” — Zhou et al., 2026

Este artículo está basado en el video AI Harness Engineering - Future of AI del canal Discover AI, los papers “Externalization in LLM Agents: A Unified Review of Memory, Skills, Protocols and Harness Engineering” (Zhou et al., Shanghai Jiao Tong University + Carnegie Mellon + OPPO, 2026) y “Problem Reductions at Scale: Agentic Integration of Computationally Hard Problems” (Pan et al., HKUST + RIKEN Japan, 2026), y es un extracto adaptado del libro “Creando Inteligencia Artificial” (~120,000 palabras, 15 capítulos con código ejecutable).

¿Te hizo pensar esto? Compártelo. ¿Tienes opiniones sobre el balance libertad vs. seguridad en IA? Los comentarios son tuyos. ¿Quieres profundizar? El libro te espera.